Le risque d’extinction peut-il être estimé de manière fiable même avec des données limitées ? – Blog des méthodes

Message fourni par Hiroshi Hakoyama.

Repenser la probabilité d’extinction en tant que critère de conservation

Penser la conservation en termes d’extinction d’espèces comme objectif sous-tend la manière dont les priorités sont fixées dans la Liste rouge de l’UICN et dans la CITES. À la base, ces cadres visent à décider quelles populations ou quels taxons devraient être prioritaires pour les efforts de conservation. Pourtant, l’analyse de viabilité de la population (PVA), qui vise à quantifier elle-même la probabilité d’extinction, fait depuis longtemps l’objet de débats. Une préoccupation récurrente est que, pour des séries chronologiques écologiques courtes et bruyantes, l’incertitude peut être si grande que les intervalles de confiance pour la probabilité d’extinction couvrent presque toute la plage 0-1, rendant les résultats pratiquement inutiles.

Il ne s’agit pas seulement d’un problème technique. Si la probabilité d’extinction ne peut pas être estimée avec une précision significative, alors tout le cadre de l’utilisation de l’extinction des espèces comme critère d’évaluation des priorités de conservation est remis en question. Dans cet article, je suis revenu sur ce problème à partir des premiers principes.

La méthode wz et les avancées théoriques en estimation

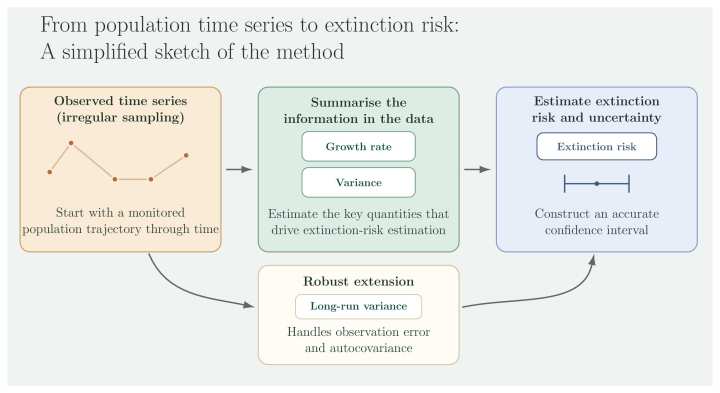

Le modèle sur lequel je me suis concentré est le processus de dérive-Wiener, l’un des modèles stochastiques de dynamique d’extinction les plus fondamentaux et les plus étudiés. Plutôt que de travailler directement avec les paramètres d’origine, je me suis concentré sur deux quantités transformées, w et z, qui déterminent la probabilité d’extinction. Cela permet de traiter analytiquement la distribution des estimateurs du maximum de vraisemblance et de dériver une méthode qui fournit des intervalles de confiance précis pour la probabilité d’extinction. C’est la méthode wz.

Le résultat principal apporte une réponse claire au débat de longue date sur le PVA. Le point clé n’est pas simplement que la précision dépend de la taille de l’échantillon. Dans ce contexte, la dépendance à l’ampleur de l’effet, c’est-à-dire à la distance entre la véritable probabilité d’extinction et le point d’incertitude maximale, peut être caractérisée analytiquement, et elle s’avère très importante : lorsque la véritable probabilité d’extinction est suffisamment faible ou suffisamment élevée, une inférence fiable est possible même à partir de séries temporelles dont la longueur ne représente qu’environ 10 à 20 % de l’horizon temporel pertinent. Au moins dans le cadre du processus Drift-Wiener, l’opinion selon laquelle la PVA n’est toujours pas informative lorsque les données sont limitées n’est donc généralement pas correcte.

Étendre le cadre aux données du monde réel : l’approche OEAR

L’article introduit également une extension pour des situations de données plus réalistes : l’estimateur robuste d’erreur d’observation et d’autocovariance, ou OEAR. Les données écologiques sont rarement idéales. Les erreurs d’observation sont courantes et les séries chronologiques contiennent souvent une autocorrélation à court terme. Dans OEAR, l’estimation naïve ML du terme de diffusion est remplacée par un estimateur basé sur la variance à long terme, utilisant des méthodes HAC avec pré-blanchiment AR (1) et un noyau de Bartlett. Cela donne une approche plus robuste en présence d’erreurs d’observation additives et de dépendance à court terme.

Un point important, cependant, est que l’OEAR n’est pas simplement un substitut supérieur au ML naïf. La méthode la plus performante dépend de la quantité de données, de l’ampleur de l’erreur d’observation et de la nature même de la dynamique de la population. Il est préférable de considérer les deux méthodes non pas comme des méthodes concurrentes, mais comme des estimateurs complémentaires, avec le ML naïf comme référence que l’OEAR est conçu pour compléter. OEAR présente également un avantage pratique : il ne nécessite pas la lourde machinerie de la modélisation de l’espace d’états.

Cet article ne s’arrête pas au modèle de base idéalisé. J’ai également effectué des analyses de sensibilité analytiques et numériques pour l’erreur d’observation, la dépendance à court terme, le bruit coloré, la faible dépendance à la densité et la non-linéarité de la CPUE. L’un des points forts de l’étude est que ses principales conclusions ne dépendent pas d’un ensemble très restreint d’hypothèses.

Application empirique : le cas de l’anguille du Japon

À titre d’application empirique, j’ai analysé deux séries chronologiques de récolte d’anguilles japonaises (Anguilla japonica) couvrant la période 1957 à 2020. Les résultats ont été frappants. Les probabilités d’extinction selon le critère E de l’UICN restent bien inférieures aux seuils des catégories menacées, même lorsque les intervalles de confiance sont pris en compte. Cela contraste clairement avec le fait que l’anguille japonaise est actuellement classée en danger selon le critère A.

Cette divergence est également cohérente avec un résultat théorique développé plus loin dans cet article. Dans le cadre du processus de dérive-Wiener, pour des populations suffisamment grandes, la partie du critère A basée sur le déclin surestime systématiquement le risque d’extinction quantifié par le critère E. Étant donné que la classification de l’UICN peut être déclenchée lorsqu’un des nombreux critères est rempli, ce type de surestimation systématique crée la possibilité d’une classification faussement positive des menaces : des espèces qui ne sont en fait pas menacées peuvent quand même être classées comme menacées. Si cela se produit, les efforts de conservation ne pourront pas être entièrement dirigés vers les taxons qui sont en réalité confrontés à un risque d’extinction plus élevé.

Ce problème n’est pas propre à l’anguille japonaise. La même logique s’appliquera probablement plus largement aux espèces marines ayant de grandes populations.

Cette étude présente un cadre d’estimation du risque d’extinction qui peut être utilisé directement dans l’évaluation de la conservation en intégrant des modèles mathématiques de dynamique des populations à la théorie statistique des intervalles de confiance. La méthode core wz est également disponible dans le package R extr sur CRAN.

J’espère que cet article sera utile non seulement aux chercheurs appliquant le critère E de l’UICN, mais également à toute personne intéressée par la manière dont l’incertitude doit être gérée dans la prise de décision en matière de conservation et par la manière dont les différents critères de la Liste rouge sont liés les uns aux autres.

Lire l’article complet ici.

Article édité par Standiwe Nomthandazo Kanyile.